Autore: Ing. Adriano Castagnone

Parte 1

Introduzione: capire gli LLM usandoli

Il modo migliore per familiarizzare con i Modelli LLM è, senza dubbio, sperimentarli in prima persona.

È attraverso l’interazione diretta, ponendo domande, chiedendo riassunti o generando testi, che si inizia a cogliere la loro potenza e le loro potenzialità. Tuttavia, per sfruttarli appieno e, soprattutto, per comprenderne i limiti e le migliori pratiche d’uso, è fondamentale possedere almeno un’infarinatura di base su come sono stati concepiti e realizzati.

Immaginiamo di guidare un’automobile: non è necessario essere meccanici per apprezzarne le prestazioni, ma conoscere i principi di funzionamento del motore, dei freni o dello sterzo rende un guidatore più consapevole e sicuro.

Allo stesso modo, per gli ingegneri civili, l’utilizzo efficace degli LLM non si limita alla semplice digitazione di un prompt. Richiede una comprensione minima dei meccanismi sottostanti che permettono a questi modelli di generare testo coerente e, a volte, sorprendentemente preciso.

Pe questo è importante demistificare gli LLM, conoscendo i principi base, anche per chi non ha un background specifico in intelligenza artificiale.

In questo e nei prossimi post non entrerò in dettagli matematici complessi o architetture neurali avanzate, esaminando i concetti chiave che permetteranno di capire “cosa c’è sotto il cofano”. Acquisire questa conoscenza consente di interagire con gli LLM in modo più efficace, di valutarne criticamente le risposte e di esplorare nuove applicazioni nel campo dell’ingegneria civile.

Scopriamo insieme come questi potenti strumenti “pensano” e come possiamo farli “pensare” per l’attività di tutti i giorni.

Che cos’è un LLM – Large Language Model

Un Large Language Model (LLM) è un sistema di intelligenza artificiale (artificial intelligence) progettato per comprendere e generare testo in linguaggio naturale (natural language). Basato su architetture di reti neurali profonde (deep neural networks), tipicamente transformer, un LLM contiene miliardi di parametri (parameters) che codificano conoscenze linguistiche e fattuali apprese durante l’addestramento (training) su vasti corpus testuali.

Il termine “Large” si riferisce non solo alle dimensioni fisiche del modello, ma soprattutto alla scala computazionale (computational scale) e alla quantità di dati elaborati. Questi modelli utilizzano meccanismi di attenzione (attention mechanisms) per catturare relazioni complesse tra parole e concetti, permettendo la generazione di testo coerente e contestualmente appropriato.

Gli LLM operano attraverso un processo di predizione probabilistica (probabilistic prediction), dove ogni parola o token viene generato basandosi sul contesto precedente. Questa capacità emergente di “comprendere” e produrre linguaggio deriva dall’identificazione di pattern statistici nei dati di addestramento (training data), senza una vera comprensione semantica nel senso umano.

Le applicazioni spaziano dalla conversazione interattiva alla traduzione, dalla scrittura creativa all’analisi testuale, rendendo gli LLM strumenti versatili per numerosi ambiti professionali e personali.

Il ruolo centrale del linguaggio naturale

Il linguaggio naturale (natural language) rappresenta il cuore pulsante degli LLM. A differenza dei linguaggi di programmazione rigidamente strutturati, il linguaggio naturale è ricco di ambiguità, sfumature e contesti impliciti. Gli LLM sono rivoluzionari proprio perché riescono a navigare questa complessità, interpretando non solo il significato letterale delle parole ma anche le intenzioni sottostanti (underlying intentions) e il contesto comunicativo.

L’elaborazione del linguaggio naturale (Natural Language Processing – NLP) negli LLM permette di:

- Comprendere domande formulate in modo colloquiale

- Gestire variazioni linguistiche, dialetti e registri comunicativi

- Inferire informazioni non esplicitamente dichiarate

- Adattare lo stile di risposta al contesto della conversazione

Questa capacità di processare il linguaggio umano nella sua forma più autentica rende gli LLM accessibili a chiunque, eliminando la necessità di imparare sintassi specifiche o comandi predefiniti.

Nei capitoli successivi esploreremo in dettaglio l’architettura tecnica, i processi di training, le modalità di deployment e le implicazioni pratiche di questi sistemi rivoluzionari.

LLM e Intelligenza Artificiale Generativa: un rapporto indissolubile

Gli LLM (Large Language Model) sono una componente fondamentale dell’Intelligenza Artificiale Generativa (AI Generativa). Quest’ultima si occupa di creare dati nuovi e originali, distinguendosi dall’IA che classifica o predice.

Gli LLM, in particolare, sono specializzati nella generazione di linguaggio umano. Addestrati su vaste quantità di testo, apprendono grammatica, sintassi, significati e contesti.

Il rapporto è di sottocategoria: ogni LLM è un modello di AI Generativa, ma non viceversa (esistono modelli generativi per immagini, audio, ecc.). La capacità degli LLM di produrre testo coerente li rende uno degli esempi più potenti e versatili dell’AI Generativa, rivoluzionando settori dalla scrittura al supporto ingegneristico. Sono gli artisti del linguaggio all’interno dell’AI Generativa.

Alla base: capire la domanda e rispondere

I modelli linguistici di grandi dimensioni (LLM) sono diventati strumenti onnipresenti, ma il loro funzionamento di base può essere riassunto in modo sorprendentemente semplice: comprendere la domanda e fornire una risposta. Questa frase, apparentemente riduttiva, cattura l’essenza di ciò che li rende così potenti e, al contempo, ne evidenzia le sfide intrinseche.

La fase di comprensione della domanda è molto più complessa di quanto sembri. Un LLM non si limita a riconoscere le singole parole, ma analizza il contesto, l’intento dell’utente, le sfumature linguistiche e persino le possibili ambiguità. Immagina di chiedere a un LLM “che ore sono?”. Non deve solo identificare “ore”, ma capire che vuoi sapere l’ora attuale, magari considerando la tua posizione geografica implicita. È qui che entrano in gioco la sua vasta conoscenza del linguaggio e la capacità di estrarre significato da input complessi, anche se formulati in modo non convenzionale.

Una volta che l’LLM ha “capito” la richiesta, il passo successivo è fornire una risposta pertinente e coerente. Questo non significa semplicemente recuperare informazioni da un database. L’LLM deve generare testo nuovo, originale, che sia grammaticalmente corretto, semanticamente accurato e stilisticamente appropriato. Può trattarsi di riassumere un articolo, scrivere una poesia, tradurre un testo o rispondere a una domanda specifica. La qualità della risposta dipende dalla sua capacità di sintetizzare, inferire e produrre linguaggio che rispecchi la comprensione acquisita. In definitiva, la genialità degli LLM risiede proprio in questa danza tra decifrazione e creazione.

Le fasi principali del funzionamento di un LLM

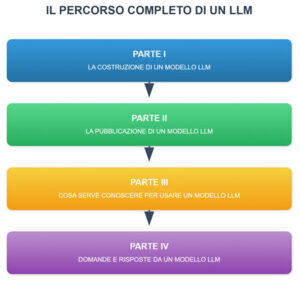

Il percorso completo di un LLM: dalle fasi principali ai dettagli operativi

Quando un utente pone una domanda a un modello di linguaggio di grandi dimensioni (LLM), apparentemente riceve una risposta in modo istantaneo e naturale. Tuttavia, dietro questa semplicità apparente si celano due fasi principali fondamentali: capire la domanda e formulare la risposta. Queste operazioni, che sembrano elementari, richiedono in realtà una complessa orchestrazione di processi che si sviluppano attraverso quattro parti essenziali, ciascuna delle quali contribuisce in modo critico al funzionamento complessivo del sistema.

PARTE I – LA COSTRUZIONE DI UN MODELLO LLM

Il primo pilastro fondamentale è la costruzione stessa del modello. Questa fase rappresenta la nascita dell’intelligenza artificiale, dove miliardi di parametri vengono addestrati su enormi quantità di testo. Durante la costruzione, il modello apprende le strutture linguistiche, le relazioni semantiche e i pattern che gli permetteranno successivamente di comprendere le domande. Attraverso tecniche come il pre-training, il fine-tuning supervisionato e il reinforcement learning from human feedback (RLHF), il modello sviluppa la capacità di interpretare il linguaggio naturale in tutte le sue sfumature. Senza questa solida base costruttiva, nessuna comprensione o generazione di risposte sarebbe possibile.

PARTE II – LA PUBBLICAZIONE DI UN MODELLO LLM

Una volta costruito, il modello deve essere reso accessibile e operativo attraverso un’infrastruttura tecnologica robusta. La pubblicazione include la containerizzazione, lo sviluppo di API, l’implementazione di sistemi di sicurezza e la creazione di interfacce utente intuitive. Questa fase è cruciale perché trasforma un modello teoricamente funzionante in un servizio pratico e scalabile. I sistemi di monitoraggio, caching e ottimizzazione delle performance garantiscono che il modello possa gestire migliaia di richieste simultanee mantenendo tempi di risposta accettabili. La pubblicazione web rappresenta il ponte tecnologico che permette agli utenti di accedere alle capacità del modello.

PARTE III – COSA SERVE CONOSCERE PER USARE UN MODELLO LLM

L’efficacia dell’interazione dipende significativamente dalla competenza dell’utente. Questa parte comprende l’apprendimento del prompt engineering, la comprensione dei limiti del modello e lo sviluppo di strategie per formulare domande efficaci. Gli utenti devono familiarizzare con concetti come il contesto, la specificità delle richieste e l’iterazione delle domande. La conoscenza di come strutturare le richieste, fornire esempi e guidare il modello verso risposte desiderate trasforma un’interazione casuale in un dialogo produttivo e mirato.

PARTE IV – DOMANDE E RISPOSTE DA UN MODELLO LLM

L’ultima parte rappresenta il culmine del processo: l’effettiva elaborazione delle domande e la generazione delle risposte. Qui entrano in gioco tutti i meccanismi operativi del modello, dalla tokenizzazione all’embedding, dall’elaborazione attraverso i layer di attenzione alla generazione autoregressiva del testo. Ogni domanda attiva una cascata di operazioni computazionali che interpretano l’intento, accedono alla conoscenza codificata nei parametri e costruiscono una risposta coerente e contestualmente appropriata.

Queste quattro parti formano un ecosistema integrato dove ogni elemento è indispensabile per il funzionamento dell’insieme. La comprensione di questo percorso completo permette di apprezzare la complessità nascosta dietro ogni interazione con un LLM e di utilizzarlo in modo più consapevole ed efficace.

Iniziare con i prompt: imparare facendo

Per conoscere davvero un LLM, non serve studiare manuali complessi: basta iniziare a fare domande! Come imparare a nuotare tuffandosi in piscina, l’approccio migliore è sperimentare direttamente.

I tre prompt proposti sono come tre porte d’ingresso: una tecnica per i curiosi del “come funziona”, una pratica per chi vuole risultati concreti, e una riflessiva per chi ama esplorare significati profondi. Provando, sbagliando e riprovando si scopre il proprio stile di dialogo con l’intelligenza artificiale.

Prompt 1: Architettura e ottimizzazione tecnica

“Analizza in dettaglio come l’architettura transformer e i meccanismi di attenzione permettono a un LLM di comprendere il contesto in una conversazione lunga. Includi esempi pratici di come il modello mantiene la coerenza attraverso multiple interazioni e quali sono le sfide tecniche nel bilanciare accuratezza e efficienza computazionale durante il deployment.”

Questo prompt esplora gli aspetti tecnici della costruzione e pubblicazione, approfondendo come le scelte architetturali influenzano le capacità operative del modello.

Prompt 2: Evoluzione del prompt engineering e best practices

“Descrivi l’evoluzione delle tecniche di prompt engineering dall’introduzione dei primi LLM ad oggi, fornendo esempi concreti di come formulare richieste efficaci per diversi casi d’uso (analisi dati, scrittura creativa, problem solving tecnico). Spiega inoltre come un utente può sviluppare una propria strategia personalizzata per massimizzare l’utilità del modello nel proprio workflow professionale.”

Questo prompt si concentra sull’aspetto pratico dell’utilizzo, collegando le capacità del modello con le competenze necessarie all’utente.

Prompt 3: Implicazioni del Natural Language Processing

“Esamina come la capacità degli LLM di processare il linguaggio naturale sta trasformando l’interazione uomo-macchina. Discuti le differenze tra la ‘comprensione’ statistica degli LLM e la comprensione umana, analizzando vantaggi, limitazioni e implicazioni etiche. Include riflessioni su come questa tecnologia potrebbe evolversi per gestire ancora meglio ambiguità linguistiche, contesti culturali e comunicazione non verbale.”

Questo prompt approfondisce il ruolo centrale del linguaggio naturale, esplorando sia gli aspetti tecnici che le implicazioni più ampie della tecnologia.